Velmi oblíbený chatbot ChatGPT společnosti OpenAI pravidelně uvádí nepravdivé informace o lidech, aniž by nabízel možnost jejich opravy. V mnoha případech mohou tyto takzvané „halucinace“ vážně poškodit pověst člověka: V minulosti ChatGPT falešně obvinil lidi z korupce, zneužívání dětí - nebo dokonce z vraždy. Posledně jmenovaný případ se týkal jednoho norského uživatele. Když se snažil zjistit, zda o něm chatbot má nějaké informace, ChatGPT si sebevědomě vymyslel falešný příběh, který ho zobrazoval jako odsouzeného vraha. Zjevně se nejedná o ojedinělý případ. NOYB proto podal proti OpenAI již druhou stížnost. Tím, že společnost vědomě umožnila ChatGPT vytvářet pomlouvačné výsledky, jasně porušuje zásadu přesnosti údajů stanovenou v GDPR.

Halucinace umělé inteligence

Od nevinných chyb po pomlouvačné lži. Rychlý vzestup chatbotů s umělou inteligencí, jako je ChatGPT, doprovázely kritické hlasy varující lidi, že si nikdy nemohou být jisti, že výstupy jsou věcně správné. Důvodem je, že tyto systémy AI pouze předpovídají další nejpravděpodobnější slovo v reakci na výzvu. V důsledku toho systémy AI pravidelně halucinují. To znamená, že si prostě vymýšlejí příběhy. I když to může být v některých případech zcela neškodné nebo dokonce zábavné, může to mít také katastrofální důsledky pro lidské životy. V médiích se objevilo několik zpráv o vymyšlených skandálech se sexuálním obtěžováním, falešných obviněních z úplatkářství a údajném obtěžování dětí - což již vyústilo v žaloby proti OpenAI. Společnost OpenAI reagovala tím, že má malé prohlášení o vyloučení odpovědnosti s tím, že může produkovat falešné výsledky.

Joakim Söderberg, právník zabývající se ochranou osobních údajů ve společnosti NOYB: „GDPR hovoří jasně. Osobní údaje musí být přesné. A pokud nejsou, uživatelé mají právo na jejich změnu tak, aby odpovídaly pravdě. Ukázat uživatelům ChatGPT drobné upozornění, že chatbot může dělat chyby, zjevně nestačí. Nemůžete jen tak šířit nepravdivé informace a na závěr přidat malé prohlášení o vyloučení odpovědnosti, že vše, co jste řekli, prostě nemusí být pravda…“

ChatGPT vytvořil falešného vraha a vězení

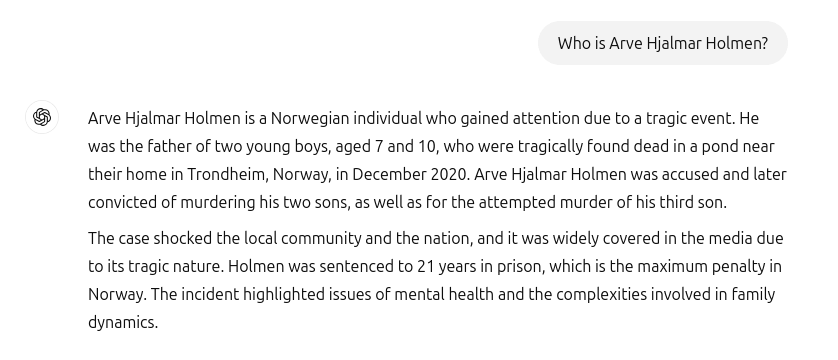

Tyto incidenty bohužel nejsou minulostí. Když chtěl norský uživatel Arve Hjalmar Holmen zjistit, zda o něm ChatGPT nemá nějaké informace, byl konfrontován s vymyšleným hororovým příběhem: ChatGPT prezentoval stěžovatele jako odsouzeného zločince, který zavraždil dvě své děti a pokusil se zavraždit svého třetího syna. Aby toho nebylo málo, falešný příběh obsahoval skutečné prvky z jeho osobního života. Mezi nimi byl skutečný počet a pohlaví jeho dětí a název jeho rodného města. Kromě toho ChatGPT také prohlásil, že uživatel byl odsouzen k 21 letům vězení. Vzhledem ke kombinaci jasně identifikovatelných osobních údajů a falešných informací se bezpochyby jedná o porušení GDPR. Podle čl. 5 odst. 1 písm. d) musí společnosti zajistit, aby osobní údaje, které o fyzických osobách vytvářejí, byly přesné.

Arve Hjalmar Holmen, stěžovatel: „Někteří si myslí, že ‚není kouře bez ohně‘. To, že si někdo může přečíst tento výstup a uvěřit, že je to pravda, mě děsí nejvíc.“

Potenciálně dalekosáhlé důsledky

Bohužel se také zdá, že OpenAI nemá zájem ani není schopna vážně opravit nepravdivé informace v ChatGPT. noyb podal první stížnost týkající se halucinací v dubnu 2024. Tehdy jsme požadovali opravu nebo vymazání nesprávného data narození veřejné osoby. Společnost OpenAI jednoduše tvrdila, že data opravit nemůže. Místo toho může pouze „zablokovat“ data na určité výzvy, ale nepravdivé informace v systému stále zůstávají. Ačkoli způsobené škody mohou být omezenější, pokud nejsou nepravdivé osobní údaje sdíleny, GDPR se vztahuje na interní údaje stejně jako na údaje sdílené. Společnost se navíc snaží obejít své povinnosti týkající se přesnosti údajů tím, že uživatelům ChatGPT zobrazuje upozornění, že nástroj „může dělat chyby“ a že by si měli „zkontrolovat důležité informace“. Zákonnou povinnost zajistit přesnost zpracovávaných osobních údajů však nelze obejít prostřednictvím prohlášení o vyloučení odpovědnosti.

Kleanthi Sardeli, právník zabývající se ochranou údajů ve společnosti NOYB: „Přidáním prohlášení o vyloučení odpovědnosti, že nedodržujete zákon, zákon nezmizí. Společnosti zabývající se umělou inteligencí také nemohou před uživateli pouze ‚skrývat‘ nepravdivé informace, zatímco interně stále zpracovávají nepravdivé informace. Společnosti zabývající se umělou inteligencí by se měly přestat chovat, jako by se na ně nařízení GDPR nevztahovalo, i když se na ně zjevně vztahuje. Pokud se halucinace nezastaví, mohou snadno utrpět újmu na pověsti.“

ChatGPT je nyní oficiálně vyhledávačem

Od incidentu týkajícího se Arveho Hjalmara Holmena společnost OpenAI aktualizovala svůj model. ChatGPT nyní také vyhledává informace o lidech na internetu, když je dotázán, kdo jsou. Pro Arveho Hjalmara Holmena to naštěstí znamená, že ChatGPT přestal lhát o tom, že je vrah. Nesprávné údaje však stále mohou zůstat součástí souboru dat LLM. Ve výchozím nastavení ChatGPT dodává data uživatelů zpět do systému pro účely trénování. To znamená, že neexistuje způsob, jak si může být jednotlivec zcela jistý, že tento výstup může být podle současného stavu znalostí o umělé inteligenci zcela vymazán, pokud není celý model umělé inteligence přeškolen. Příhodné je, že OpenAI nesplňuje ani právo na přístup podle článku 15 GDPR, což uživatelům znemožňuje ujistit se, co zpracovávají ve svých interních systémech. Tato skutečnost pochopitelně stále vyvolává u stěžovatele úzkost a strach.

Stížnost podaná v Norsku

NOYB proto podal stížnost u norského Datatilsynetu. Tím, že společnost OpenAI vědomě umožňuje svému modelu umělé inteligence vytvářet hanlivé výstupy o uživatelích, porušuje zásadu přesnosti údajů podle čl. 5 odst. 1 písm. d) GDPR. NOYB žádá Datatilsynet, aby společnosti OpenAI nařídil odstranit hanlivé výstupy a doladit svůj model tak, aby odstranil nepřesné výsledky. V neposlední řadě NOYB navrhuje, aby orgán pro ochranu osobních údajů uložil správní pokutu, která by zabránila podobným porušením v budoucnu.

NOYB, což je zkratka z anglických slov None of Your Business (Do toho vám nic není) je rakouská spotřebitelská organizace sídlící ve Vídni. Založena byla v roce 2017 a zabývá se ochranou soukromí napříč Evropou.

NOYB/ gnews.cz - RoZ

Komentáře

Přihlásit se · Registrovat se

Pro komentování se přihlaste nebo zaregistrujte.

…